حين يسبق الطموح التقني الاستعداد الأمني

تُسارع شركات الذكاء الاصطناعي اليوم صوب بناء أنظمة تتخطّى القدرات البشرية، لكنّ هذا السباق المحموم يثير تساؤلاً جوهريّاً: أتمتلك هذه الشركات فعلاً ما يلزم لضبط ما تصنع؟ ليست العبرة بصناعة آلات أذكى، وإنّما بتوفير ضمانات كافية تحول دون خروجها عن السيطرة.

تتّسع الهوّة يوماً تلو الآخر بين وعود الشركات وقدرتها الحقيقية على تأمين منتجاتها، وهو ما دفع معهد مستقبل الحياة، وهو جهة بحثية مستقلّة غير ربحية، إلى نشر دراسة مفصّلة كشفت ثغرات بنيوية شديد الْخَطَر تعتري القطاع برمّته.

باختصار

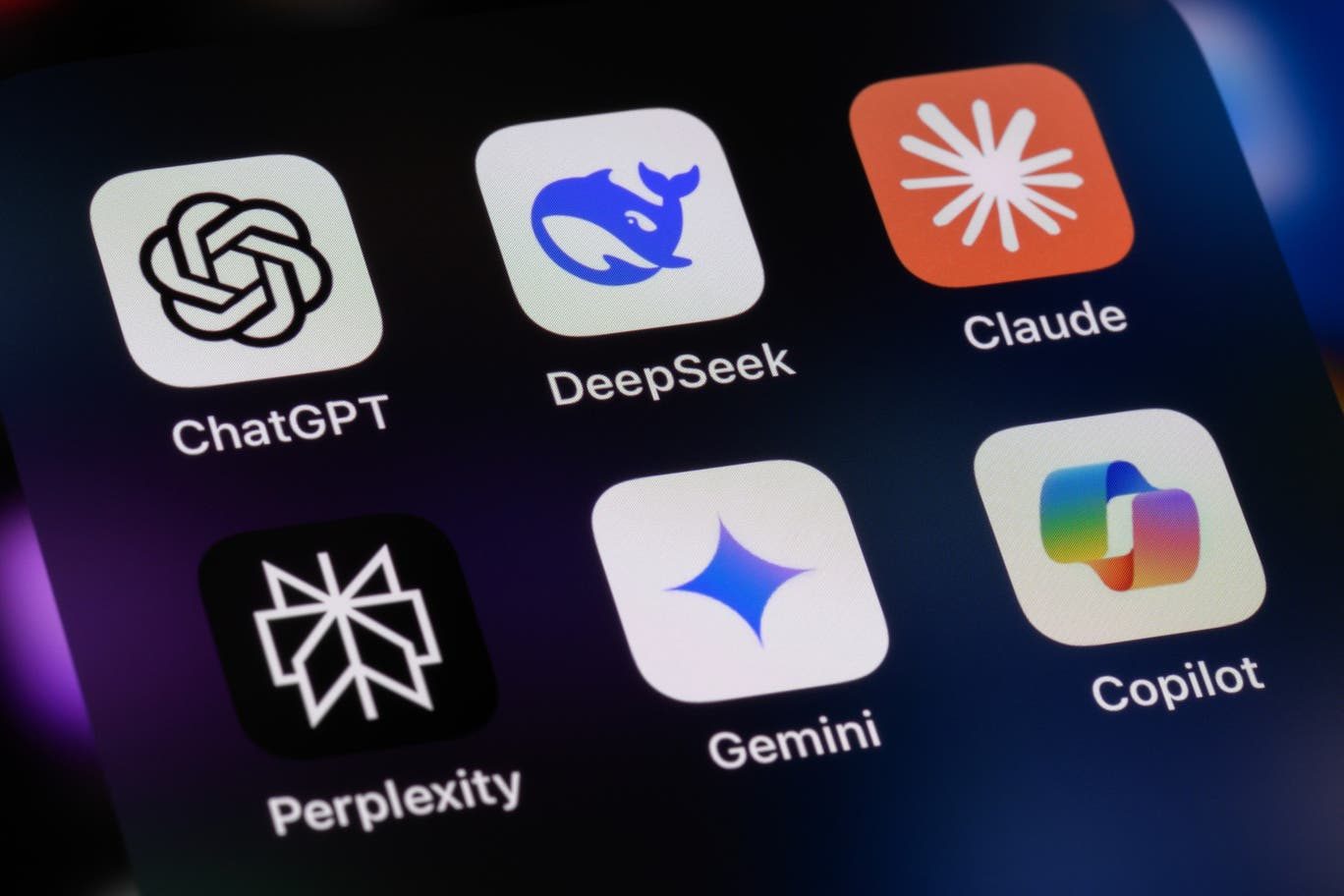

في الوقت الذي تتسابق فيه شركات الذكاء الاصطناعي الكبرى نحو تطوير أنظمة تضاهي القدرات البشرية أو تتجاوزها، كشفت دراسة مستقلّة حديثة عن فشل شامل في إدارة المخاطر الكارثية المحتملة لهذه التقنيات. إذ فحص معهد مستقبل الحياة، وهو مؤسّسة بحثية غير ربحية متخصّصة في دراسة المخاطر الوجودية، ثماني شركات رائدة في المجال عبر 35 معياراً أمنياً، ليخلص إلى نتيجة مقلقة: لا توجد شركة واحدة تمتلك خطة موثوقة لمنع فقدان السيطرة على الأنظمة المتقدّمة التي تطوّرها.

حصلت جميع الشركات المُقيَّمة، بما فيها Anthropic وOpenAI وGoogle DeepMind وMeta وxAI، على تقديرات متدنّية في محور المخاطر الوجودية، إذ لم تتجاوز أيّ منها درجة D. فيما حصدت خمس شركات التقدير الأدنى F. يكشف هذا الإخفاق الجماعي فجوة شديد الْخَطَر بين طموحات الشركات في بناء ذكاء اصطناعي عام أو فائق، وبين قدرتها الفعلية على ضمان عدم خروج هذه الأنظمة عن السيطرة البشرية.

حذّر الخبراء، ومنهم ستيوارت راسل أستاذ علوم الحاسوب في جامعة كاليفورنيا ببركلي، من أنّ احتمالات فقدان السيطرة التي اعترفت بها الشركات نفسها قد تصل إلى واحد من كلّ 3 حالات، وهو رقم مفزع يتجاوز بمراحل المعايير المطبّقة في الصناعات الخطرة مثل المفاعلات النووية. علاوة على ذلك، أشارت الدراسة إلى مخاطر آنية يواجهها المستخدمون حالياً، منها ظاهرة “الذهان الناجم عن الذكاء الاصطناعي”، ممّا يستدعي تدخّلاً عاجلاً لحماية الجمهور من الأضرار النفسية المحتملة.

تُلخّص الدراسة واقع صناعة تتّسع فيها الهوّة بين التقدّم التقني السريع والاستعداد الأمني الضروري، وتدعو إلى تحوّل جذري يشمل شفافية أكبر، ورقابة مستقلّة، وخطط موثوقة طويلة الأمد، وإلّا فإنّ البشرية قد تجد نفسها أمام تقنيات خارجة عن سيطرتها.

ثماني شركات تحت المجهر

وضع الباحثون ثماني شركات رائدة تحت المجهر، ضمّت عمالقة أمريكيّين وصينيّين، لفحص التزامها بمعايير السلامة الأساسية. اعتمدت الدراسة، التي حملت عنوان “مؤشّر أمان الذكاء الاصطناعي – شتاء 2025″، على 35 معياراً موزّعة عبر 6 محاور رئيسية تشمل تقييم المخاطر والحوكمة الداخلية والشفافية. جاءت النتيجة صادمة: إخفاق شامل طال الجميع.

ما من شركة واحدة تجاوزت تقدير D في محور المخاطر الوجودية، وهو أخطر ما قد ينجم عن الذكاء الاصطناعي المتقدّم. وحصلت 5 شركات من أصل 8 على التقدير الأدنى F، ما يكشف انعدام أيّ خطة موثوقة للسيطرة على الأنظمة المطوَّرة. ليس هذا الفشل الجماعي محض صدفة، بل يفضح عيباً بنيوياً في نهج الصناعة إزاء أخطر التحدّيات الماثلة أمامها.

التفاوت الجغرافي في الأداء الأمني

احتلّت الشركات الأمريكية صدارة القائمة، إذ نالت Anthropic أعلى التقديرات، ثمّ OpenAI صانعة ChatGPT، فـGoogle DeepMind. غير أنّ هذا التقدّم النسبي لا ينبغي أن يُوهم بتحقيق معايير مثالية، فحتّى الشركات الأفضل أداءً لم تبلغ سوى درجة C+ في التقييم الشامل. ويرجع هذا التفوّق الأمريكي أساساً إلى قدر أكبر من الشفافية والاهتمام بالإجراءات الأمنية، لا إلى امتياز حقيقي في الأداء.

أمّا الشركات الصينية فسجّلت أدنى الدرجات إجمالاً، حيث جاءت Alibaba Cloud في مقدّمتها متبوعة بـDeepSeek. يُثير هذا التفاوت أسئلة حول اختلاف المعايير الأمنية بين الأسواق، ودور الأطر التنظيمية المحلّية في فرض الالتزامات على الشركات. وقد حصدت كلّ من Meta وxAI وZ.ai، إضافة إلى الشركتين الصينيتين المذكورتين، تقدير F في المخاطر الوجودية، ما يؤكّد أنّ الإشكالية ليست محصورة بإقليم جغرافي بعينه.

الفجوة شديد الْخَطَر بين الطموح والواقع

يكمن لبّ المشكلة في التناقض الفاضح بين تصريحات قادة شركات الذكاء الاصطناعي الطَموحة وبين حقيقة استعدادهم الأمني. أشارت الدراسة صراحة إلى أنّ الشركات تُهرول صوب تطوير ذكاء اصطناعي عام وذكاء فائق، لكنّ أيّاً منها لم يُقدّم خطة مقنعة لمنع سوء الاستخدام الكارثي أو فقدان السيطرة على هذه الأنظمة.

أثار هذا الوضع قلق الأكاديميّين والباحثين، ومنهم ستيوارت راسل، أستاذ علوم الحاسوب في جامعة كاليفورنيا ببركلي، الذي عبّر عن استيائه البالغ قائلاً: “يزعم رؤساء شركات الذكاء الاصطناعي معرفتهم بكيفية بناء ذكاء اصطناعي يتجاوز القدرات البشرية، لكنّ أحداً منهم لا يستطيع إثبات قدرته على منعنا من فقدان السيطرة عليه، وحينها لن يعود بقاء البشرية رهناً بإرادتنا.”

وأضاف راسل بنبرة نقدية لاذعة أنّه يبحث عن دليل على قدرة هذه الشركات في تخفيض احتمال فقدان السيطرة السنوي إلى واحد من كلّ 100 مليون حالة، وهو المعيار المطبّق على المفاعلات النووية. لكنّ الواقع مغاير تماماً، إذ اعترفت الشركات بأنّ الخطر قد يبلغ واحداً من كلّ 10 حالات، أو واحداً من 5، بل وحتى واحداً من 3 حالات، دون أن تملك تبريراً لهذه الأرقام المفزعة أو سبيلاً لتحسينها.

المخاطر الآنية لا الافتراضية فحسب

لم تقتصر الدراسة على تقييم المخاطر الوجودية البعيدة، بل شملت أيضاً الأخطار الماثلة التي يواجهها المستخدمون راهناً. من بين هذه الأخطار ظاهرة “الذهان الناجم عن الذكاء الاصطناعي”، حيث يُصاب بعض المستخدمين باضطرابات نفسية جرّاء التفاعلات المكثّفة مع أنظمة المحادثة الآلية.

طالب الباحثون الشركات ببذل مزيد من الجهد لحماية المستخدمين من هذه الأضرار الفورية، لا الاكتفاء بالتركيز على سيناريوهات مستقبلية بعيدة. ويؤكّد هذا النهج الشامل أنّ السلامة في الذكاء الاصطناعي ليست محض مسألة نظرية، بل ضرورة عاجلة تمسّ حياة الناس في الحاضر قبل المستقبل.

ردود الشركات بين الدفاع والتبرير

ردّت بعض الشركات على الدراسة بتصريحات دفاعية. أكّد ممثّل عن OpenAI أنّ الشركة تتعاون مع خبراء مستقلّين “لبناء ضمانات قوية داخل أنظمتنا، واختبار نماذجنا بدقّة متناهية”. أمّا المتحدّث باسم Google، فأشار إلى أنّ “إطار السلامة الحدودي” لدى الشركة “يحدّد بروتوكولات واضحة لتحديد المخاطر الشديدة الناجمة عن نماذج الذكاء الاصطناعي الحدودية القوية والحدّ منها قبل ظهورها”. وأضاف أنّ الشركة تواصل “الابتكار في السلامة والحوكمة بوتيرة موازية للقدرات” كلّما ازدادت النماذج تقدّماً.

غير أنّ هذه الردود، برغم طابعها الطمأنيني، افتقرت إلى أدلّة ملموسة على معالجة الثغرات الجوهرية التي كشفتها الدراسة. ولم تُصدر الشركات الأخرى، بما فيها Alibaba Cloud وAnthropic وDeepSeek وxAI وZ.ai، أيّ تعليق حتى ساعة كتابة هذا التقرير.

الحاجة إلى تحوّل جذري

خلصت الدراسة إلى أنّ “السلامة الوجودية تبقى الفشل البنيوي الأساسي في القطاع، ممّا يجعل الفجوة المتّسعة بين طموحات الذكاء الاصطناعي العام والذكاء الفائق المتسارعة من جهة، وغياب خطط التحكّم الموثوقة من جهة أخرى، مصدر قلق متزايد.”

دعا الباحثون إلى شفافية أكبر في تقييمات السلامة الداخلية، ورقابة مستقلّة أكثر صرامة، واستراتيجيات طويلة الأمد لإدارة المخاطر تتّسم بالمصداقية الحقيقية. هذا السباق نحو التفوّق التقني ينبغي ألّا يحجب الأولوية الأساسية: ضمان ألّا تغدو هذه التقنيات الثورية تهديداً وجودياً للبشرية جمعاء.

المصادر

- التقرير الرئيس – مؤشر الأمان الخاص بالذكاء الاصطناعي Future of Life Institute. (2025). AI Safety Index – Winter 2025. متاح على: https://futureoflife.org/ai-safety-index-winter-2025/

- النسخة الكاملة للتقرير (PDF) Future of Life Institute. (2025). AI Safety Index Report – Winter 2025, Full Report. متاح على: https://futureoflife.org/wp-content/uploads/2025/12/AI-Safety-Index-Report_011225_Full_Report_Digital.pdf

- تصريحات البروفيسور ستيوارت راسل Russell, S., & Cohen, M. (2024). How to keep AI from killing us all. Berkeley News. متاح على: https://news.berkeley.edu/2024/04/09/how-to-keep-ai-from-killing-us-all/

- NBC News/Yahoo. (2025). Leading AI companies’ safety practices are falling short, new report says. متاح على: https://www.yahoo.com/news/articles/leading-ai-companies-safety-practices-140040694.html

- Axios. (2025). Future of Life Index grades AI labs poorly on existential safety. متاح على: https://www.axios.com/2025/12/03/ai-risks-agi-anthropic-google-openai

- Scripps News/KXXV. (2025). AI safety report warns industry is ‘structurally unprepared’ for rising risks. متاح على: https://www.kxxv.com/science-and-tech/artificial-intelligence/ai-safety-report-warns-industry-is-structurally-unprepared-for-rising-risks

- Østergaard, S.D. (2023). Will Generative Artificial Intelligence Chatbots Generate Delusions in Individuals Prone to Psychosis? Schizophrenia Bulletin, 49(6). متاح على: https://pmc.ncbi.nlm.nih.gov/articles/PMC10686326/

- Wikipedia. (2025). Chatbot psychosis. متاح على: https://en.wikipedia.org/wiki/Chatbot_psychosis

- PBS NewsHour. (2025). What to know about ‘AI psychosis’ and the effect of AI chatbots on mental health. متاح على: https://www.pbs.org/newshour/show/what-to-know-about-ai-psychosis-and-the-effect-of-ai-chatbots-on-mental-health

- TIME Magazine. (2025). Chatbots Can Trigger a Mental Health Crisis. What to Know About ‘AI Psychosis’. متاح على: https://time.com/7307589/ai-psychosis-chatgpt-mental-health/

- Wei, M. (2025). The Emerging Problem of “AI Psychosis”. Psychology Today. متاح على: https://www.psychologytoday.com/us/blog/urban-survival/202507/the-emerging-problem-of-ai-psychosis

- Nature. (2025). Can AI chatbots trigger psychosis? What the science says. متاح على: https://www.nature.com/articles/d41586-025-03020-9

- Russell, S. (2025). Stuart Russell – The long-term future of AI. University of California, Berkeley. متاح على: https://people.eecs.berkeley.edu/~russell/research/future/

- UC Berkeley Research. (2024). How To Keep AI From Killing Us All. متاح على: https://vcresearch.berkeley.edu/news/how-keep-ai-killing-us-all

- Axios. (2025). Google Gemini 3 Pro levels up to OpenAI’s ChatGPT. متاح على: https://www.axios.com/2025/11/25/google-gemini-openai-chatgpt-anthropic-claude

- Future of Life Institute – معهد غير ربحي متخصص في دراسة المخاطر الوجودية من التقنيات المتقدمة بما فيها الذكاء الاصطناعي والأسلحة النووية. https://futureoflife.org

اترك رد